Vorbemerkung: Alle meine Beiträge spiegeln meine persönliche Meinung und Anschauung zu Themen aus Naturwissenschaft, Technik aber auch Psychologie wider. Sie sind weder methodisch noch inhaltlich nach einem höheren Konzept korrekt und sind daher bestenfalls als Denkanstöße zu verstehen.

Unsere Zeit hat viele Gesichter und man weiß gar nicht, wo man anfangen soll, wenn man sich einer Charakterisierung annähert. Ein Zeichen der Zeit, dem wohl viele zustimmen würden, wäre die Aussage: “Wir leben im Zeitalter der Computer!”.

Der 66 Generation kommt dabei einer besondere Schlüsselrolle zu. In Deutschland und sicherlich in vielen anderen Ländern der Erde wurde zum ersten Mal ein elektronischer Taschenrechner 1978 als ultimatives Lernhilfsmittel für alle Schüler eingeführt (dass es dabei in deutschen Schulen fast geblieben wäre, das ist eine andere traurige Geschichte ;-)).

Den ersten Computer, den ich sah, der eben schon mehr als “nur” mit Zahlen rechnen konnte, war der ZX-80 von Sinclaire, der Texte und auch schon Grafiken auf silberbeschichtetes Papier drucken konnte, nicht zu vergessen der Commodore 64 mit seiner Datasette.

Das ist nun alles schon lange her und heute haben Neuroinformatiker kein Problem mehr damit zu sagen, dass der Mensch halt ein Bio-Computer ist. Unter dieser Prämisse lebt die Menschheit also ständig im Zeitalter des Computers.

Was ist nun mit Bio-Computer gemeint? Ich reduziere diese komplexe Fragestellung mal auf ein einfaches Model. Man kann das Gehirn in drei sehr grobe Bereiche aufteilen:

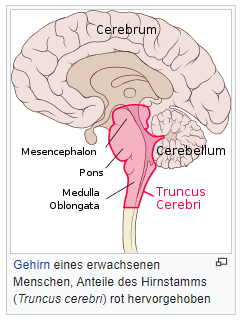

- das Stammhirn auch Reptilienhirn genannt

- das Zwischenhirn auch Chemie Hirn genannt

- das Großhirn, die Krone der Schöpfung 😉

Jetzt wird es mal Zeit für Bilder:

Das Stammhirn hatten schon die Dinosaurier. Es enthält die wesentlichen Basis Steuerungseinheiten eines komplexeren Lebewesens, wie z.B.:

- Temperaturkontrolle

- Atmungsfrequenz

- Herzschlag Frequenz

- Blutdruckkontrolle

- Reflexkontrolle

Als Analogon im Computerbereich könnte man hier das BIOS (Basic Input/Output System) benennen, dass BIOS enthält die Basis Routinen mit denen man mit dem Computer kommuniziert wie Tastatur, Mouse click, Touch Events.

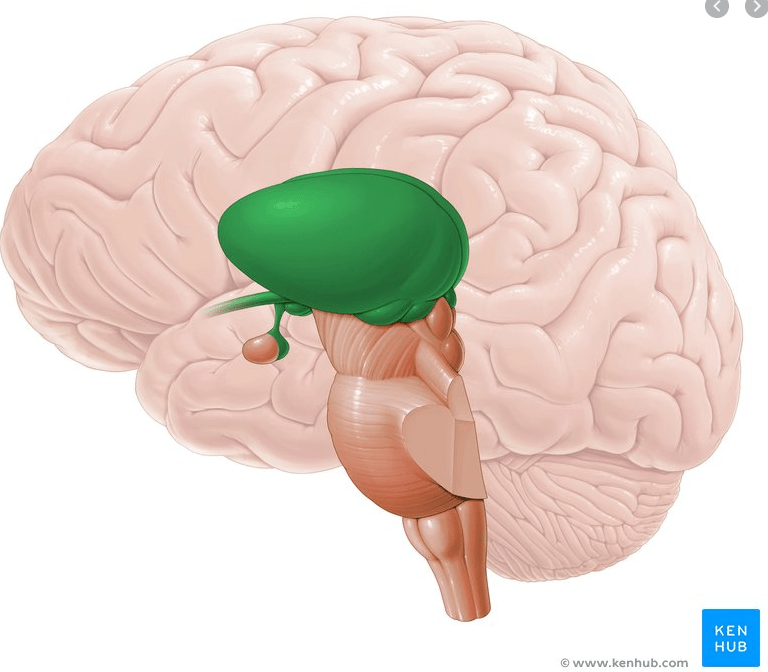

Nun kommen wir zur wirklichen Problemstelle dem Zwischenhirn. Es heißt Zwischenhirn, weil es eben zwischen Stammhirn und Großhirn liegt. Evolutionshistorisch betrachtet bildete sich das Zwischenhirn mit den Säugetieren also nach dem Aussterben der Dinosaurier aus. Es ist für die Gefühle verantwortlich. Eine riesige Chemiefabrik mit besten Auslieferungslogistik in den ganzen Körper. Fast alle psychische Erkrankungen gehen auf Defekte des Zwischenhirns zurück.

Der berühmte Herz/Kopf Konflikt kommt eben dadurch zustande, dass die Verarbeitung von z.B. Logik und räumlicher Orientierung im Großhirn, die Gefühle aber im autonomen Bereich des Zwischenhirns angesiedelt sind. Es gibt natürlich Schnittstellen zwischen den Gehirnteilen aber ihre wesentlichen Funktionen führen sie autonom durch. Daher kann die Ratio nicht einfach die Emotion “überschreiben”, auch wenn sie noch so viele Argumente aus dem Großhirn “hervorzaubert” ;-). Da eben alle Säugetiere über ein Zwischenhirn verfügen, wundert es nicht, dass wir gerade bei unseren liebsten Haustieren, wie Hund und Katze bestens unseren eigenen Gefühlsschwankungen beobachten können. Einen Gefühlszustand verdanken wir aber doch den Dinosauriern und das ist der Zustand des Zornes (krankhaft) mit Aktivierung zum Kampf. Das ist der Raptus, Tyrannosaurus Rex lässt grüßen. Eben doch nicht ganz ausgestorben.

Hier fällt es mir doch schwer einen sinnvollen Vergleich zum Silizium Chip Computer zu finden. Es erinnert mich nur an die “Hybrid” Figur Data als sie etwas skeptisch aber auch fasziniert zum ersten Mal den “Emotions” Chip in ihren “Gehirnslot” einführt. Wer da noch tiefer einsteigen will dem sei folgender Link empfohlen (für die Hard Core Star Treck Fans 😉 https://memory-alpha.fandom.com/de/wiki/Emotionschip ).

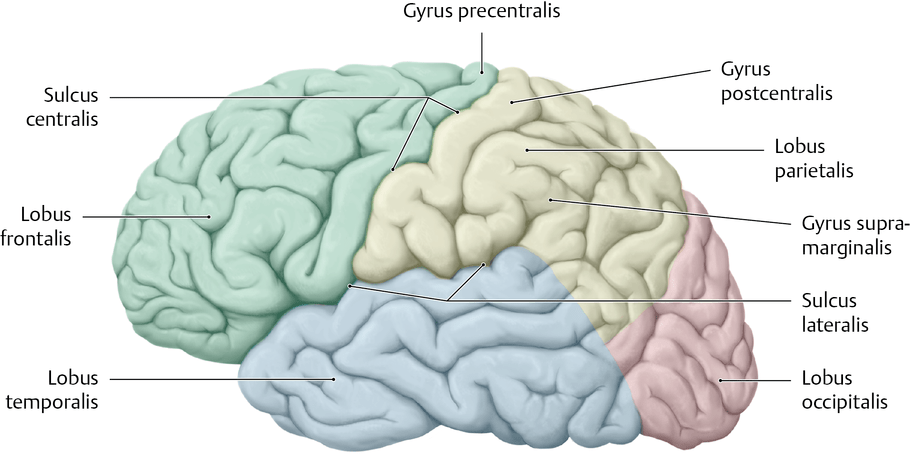

Kommen wir zur Krone der Schöpfung dem Großhirn.

Hier noch eine Kurzbeschreibung aus der Internetseite Dr. Gumpert (www.dr-gumpert.de/html/aufgaben_vom_grosshirn.html):

Das Großhirn ist der Teil vom Gehirn, der wohl am weitläufigsten bekannt ist. Es wird auch als Endhirn oder Telencephalon bezeichnet und macht den größten Teil des menschlichen Gehirns aus. In dieser Ausprägung und Größe ist es auch nur beim Menschen vorhanden.

Grob unterscheidet man am Großhirn vier Lappen, die in Bezug auf ihre anatomische Lage benannt sind und zwei gesonderte, in der Tiefe liegende Bereiche. Genauer wird die Großhirnrinde in 52 sogenannte Brodmann Areale eingeteilt, benannt nach ihrem Erstbeschreiber Korbinian Brodmann. Es ist in zwei Hälften, den Hemisphären, aufgeteilt.

Um eine möglichst große Oberfläche zu haben, ist es vielfach gefaltet. Die aufgeworfenen Windungen und entstandenen Furchen tragen eigene Namen und können bestimmten Funktionsgebieten zugeteilt werden.

Das Großhirn ist die höchste Instanz des “Zentralen Nervensystems“, zu dem neben dem Gehirn auch das Rückenmark zählt, und macht den Menschen mit all seinen emotionalen, psychischen und motorischen Fertigkeiten überhaupt erst zu dem, der er bzw. sie ist. Es ist in alle aktiven Gedanken und Bewegungsabläufe eingebunden, verarbeitet eingehende Informationen und produziert daraufhin zielgerichtet Antworten und Reaktionen. Dabei ist es über Nervenbahnen vielfach mit sich selber und weiteren Hirnstrukturen verknüpft. In der Großhirnrinde liegen die Nervenkerne, im Mark die Nervenbahnen.

Sprich es ist die CPU, die über ihre internen Datenbusse mit Hilfe aller externen Schnittstellen von USB bis HDMI die Persönlichkeit abrundet. Die externen Devices sind aber eben keine Hochglanzmonitore mit ihren Graphikkarten und super Stereo Soundkarten sondern “einfach” nur Beine, Arme, Hals und ein Kopf, der sehen, hören, schmecken kann. Nicht zu vergessen steuert es auch einen verteilten Sensor, genannt Haut, um Dinge zu ertasten und deren Temperatur zu testen.

Man könnte sicherlich noch sehr viel genauere verschiedene Funktionseinheiten des Großhirns versus Funktionsgruppen eines Computers aufstellen, ich möchte aber aufzeigen, dass es in der algorithmischen Verarbeitung zwischen Computer und dem menschen eine gemeinsame Strategie gibt:

Die scheinbare Parallelverabeitung.

Die Parallelverarbeitung von Algorithmen war und ist in der Informatik ein riesen Thema. Häufig wird das unter dem Stichwort Multi Tasking zusammengefasst.

Es ist jedem sehr offensichtlich, dass es Aufgabenstellungen gibt, die sich relativ leicht parallelisieren lassen, wenn zumindest die Ressourcen hat. Ein Beispiel: Man soll zehn Liter Wasser möglichst schnell von A nach B bringen und hat zufällig 10 Eimer a einem Liter. Ohne groß zu überlegen entscheidet man sich für fünf Menschen mit je zwei Armen und kann damit die Aufgabe am schnellsten lösen. Doch es gibt Aufgabestellungen, die lassen sich nicht so leicht parallelisieren. Sollte man z.B. auf die Idee kommen neun Frauen zu schwängern in der Hoffnung nach einem Monat ein Kind zu haben, wird man(n) doch feststellen, dass stattdessen nach neun Monaten neun Kinder da sind, Parallelisierung fehlgeschlagen.

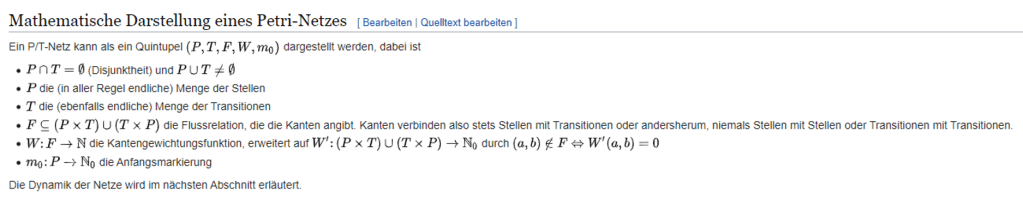

Die Antwort der Informatiker ist (u.a.) das Petri Netz aus der Theorie endlicher Zustandsautomaten. Wenn ihr mich jetzt fragt, was sind denn das für Netze, da mache ich es jetzt so, wie unser Informatik Professor Balzert, der leider mehr interessiert war seine Bücher zu vermarkten, anstatt sein Wissen zu lehren. Trotzdem haben seine Vorlesungen mein Leben am nachhaltigsten verändert ;-).

Außerdem habe ich mir immer gemerkt, dass ein Compiler ein Quadro Tupel aus “non terminalen” Symbolen, terminalen Symbolen einer Grammatik und Produktionsregeln ist. Wir haben damals in der Vorlesung auch nicht schlecht gestaunt und versuchten die Zeichen zu verstehen und irgendwann machte es Klick und da sind wir beim ganz wesentlichen Teil von Parallelverarbeitung: Es geht darum verschiedenste Aufgaben möglichst zeitnah gelöst zu bekommen, so dass es einem wie gleichzeitig vorkommt.

Hier können sowohl Programmierer wie auch das Betriebssystem eine entscheidende Möglichkeit bei der Verabeitung von Befehlen nutzen: synchroner oder asynchroner Funktionsaufrufmechanismus.

Als typisches Beispiel für den synchronen Funktionsmechanismus sei das Telefonat genannt. Anrufer A ruft B an, weil er dringend eine Antwort von B benötigt. Das Telefon dient nur der Synchronisierung von Frage und Antwort. Wenn alles glatt geht, dann hat A relativ schnell seine Antwort. Die Klarheit in der Abfolge der Kommunikation bei der synchronen Methode ist ihre Stärke aber auch ihre Schwäche zugleich. Denn hat A den Kommunikationspartner wirklich unter ‘Kontrolle’? B hat vielleicht keine Zeit und geht gar nicht an den Anruf dran. A hat dann Zeit vertan, ohne ein Schritt weiter gekommen zu sein. Als Alternative bietet sich dann die asynchrone Kommunikation an. Als Beispiel erwähne ich den berühmten vergessenen Einkaufszettel. Man ist ausser Haus und wollte auf dem Rückweg noch einkaufen und hat die Einkaufsliste vergessen. Man braucht die Liste nicht sofort, aber man weiß, dass der Partner oder die Partnerin zu Hause ist und sicherlich mal auf das Handy schaut und dann den Einkaufszettel schickt. Der Informatiker nennt eine solche Kommunikation ‘loosely coupled‘. Damit das funktioniert, muss der Absender A eine klare ‘call back‘ Adresse hinterlassen. Und der Absender sollte es mit seinen asynchronen Anfragen nicht übertreiben, nach dem Motto: Wenn du gerade beim Einkaufszettel bist, kannst Du noch das und das tun… Das kommt weder bei Bio- noch Silizium Computern gut an. Informatiker nennen diese Situation: Der Request Stack ist überlastet.

Während die beiden obigen Beispiele sehr bewusst ablaufen, tritt die asynchrone Kommunikationsmethode (auch mit uns selbst) oft sehr unbewusst ohne direkte Steuerung auf. Das klassische Beispiel ist der vergessene Film beim Gespräch mit einem Freund. Während des Gesprächs erinnert sich weder der Freund noch man selbst daran aber trotzdem wissen beide welcher Film / Schauspieler gemeint ist. Tage später poppt auf einmal der Name auf, wenn man z.B. entspannt unter der Dusche steht.

Was ist hier passiert? Ohne dass man es bemerkte, wurde ein “asynchroner Service Request” an das Gedächtnis ausgelöst. Asynchron, weil zunächst keine Antwort gefunden wird und es noch viele andere Aufgaben zu lösen gibt. Aber die Frage nach dem Names des Films/Schauspielers ist im Kopf und immer, wenn mal wieder Zeit da ist weiter im Gedächtnis zu suchen, macht es auch das Gehirn. Genauso wie ein Computer einem Programm vom “Idle Mode” in den “Run Mode” nach einem strikten Prioritäten Plan aktiviert. Hat das Programm seine Aufgabe erfüllt, so teilt es dies dem Betriebssystem mit, welches dann das Programm aus der Prozessliste streicht. Es ist auch kein Wunder, dass die Antwort auf den Filmnamen gerade in entspannten Phasen aufkommt, denn nun ist der Kopf “frei” und andere Prozesse “stehlen” keine wichtigen Ressourcen, um im Gedächtnis zu suchen. Solche zumeist unbewussten Erinnerungsvorgänge sind ungemein wichtig für die Restrukturierung des Gedächtnisses wie ein Festplattenreorganisation.

Bleibt zum Schluss die Frage, wenn wir so etwas wie Bio-Computer sind, wer schreibt eigentlich die Software? Dazu gibt es auf Youtube einen netten Vortrag vom Royal Institute of Science.

Ich möchte keinem zu nahetreten, der sich mit der Bezeichnung Bio-Computer eher diskriminiert fühlt. Doch mir scheint eines sicher, keine Maschine, die der Mensch je erschaffen hat, sagt mehr über uns aus als der Computer. Eine Beschäftigung mit dem Computer ist auch immer eine Auseinandersetzung mit uns selbst.